【事業概要】

リライアブルテクノロジーでは、高性能カメラモジュールとAI演算機能の融合により、よりスマートで自立型な視覚ソリューションを提供しています。

モジュール設計・基板開発・製造・検証まで一貫対応し、OEM/ODM案件にも柔軟に対応可能です。

【主な提供内容】

✅ 高性能カメラモジュールの設計・製造

- 解像度:HD~4K以上

- センサー:CMOS・CCD/グローバル・ローリングシャッター

- インターフェース:USB3.0、MIPI-CSI、LVDS、CameraLink など

- 筐体設計:小型/耐環境(防塵・耐熱)対応

✅ AIプロセッサ統合モジュール

- NPU/DSP/Edge TPU/Jetson/RKシリーズ など実装可能

- AIによる画像分類・物体検知・姿勢推定・異常検知 などに対応

- クラウドレスのエッジ処理でリアルタイム応答性を実現

【活用分野例】

| 分野 | 活用事例 |

|---|---|

| 製造・検査 | 外観検査、NG品判定、QR/OCR読み取り |

| 物流・倉庫 | 棚認識、在庫チェック、バーコード追跡 |

| 医療・ヘルスケア | 顕微鏡映像認識、患者行動検知 |

| スマートシティ | 車両検出、違反検知、防犯記録 |

| 小売・サイネージ | 顧客分析、混雑状況判定、購買行動分析 |

【強み・特徴】

- 高信頼性 × 省スペース設計対応(超小型実装可)

- AIモデル(YOLO, MobileNet等)をプリロードして納品可

- 少量ロットや短納期対応も可能

- 海外規格(CE・FCC)/産業認証にも対応

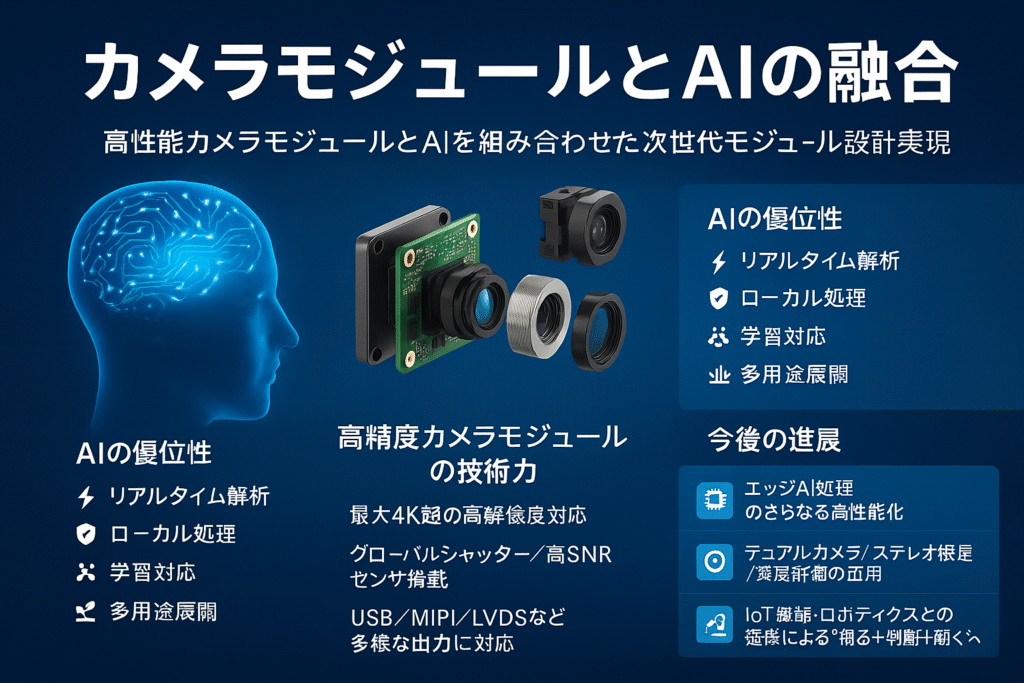

🔷 カメラモジュールとAIの融合 ― 次世代の視覚ソリューションへ

リライアブルテクノロジーは、高性能カメラモジュールとAI演算技術を融合した次世代モジュール設計を展開しています。

従来の「見る」だけのカメラから、「理解する」カメラへ。AI搭載により、画像解析・物体認識・異常検出などをリアルタイムかつ自律的に処理することで、クラウドレスなインテリジェンスを実現します。

🔷 AIの優位性

- ✅ リアルタイム解析:遅延のない即時応答

- ✅ ローカル処理:クラウド不要でセキュリティ性向上

- ✅ 学習対応:現場に合わせてAIモデルを最適化可能

- ✅ 多用途展開:製造・医療・物流・スマートシティまで対応

🔷 高精度カメラモジュールの技術力

- 最大4K超の高解像度対応

- グローバルシャッター/高SNRセンサ搭載

- USB/MIPI/LVDSなど多様な出力に対応

- 狭スペースへの組み込みを可能にする超小型筐体設計

- AIチップ(NPU/Jetson Nano/Edge TPU)との統合設計も可能

🔷 今後の進展

- エッジAI処理のさらなる高性能化

- デュアルカメラ/ステレオ視差/深度計測の応用

- IoT機器・ロボティクスとの連携による“視る+判断+動く”統合へ

- 顧客用途別のマスカスタマイゼーション(特注量産対応)強化

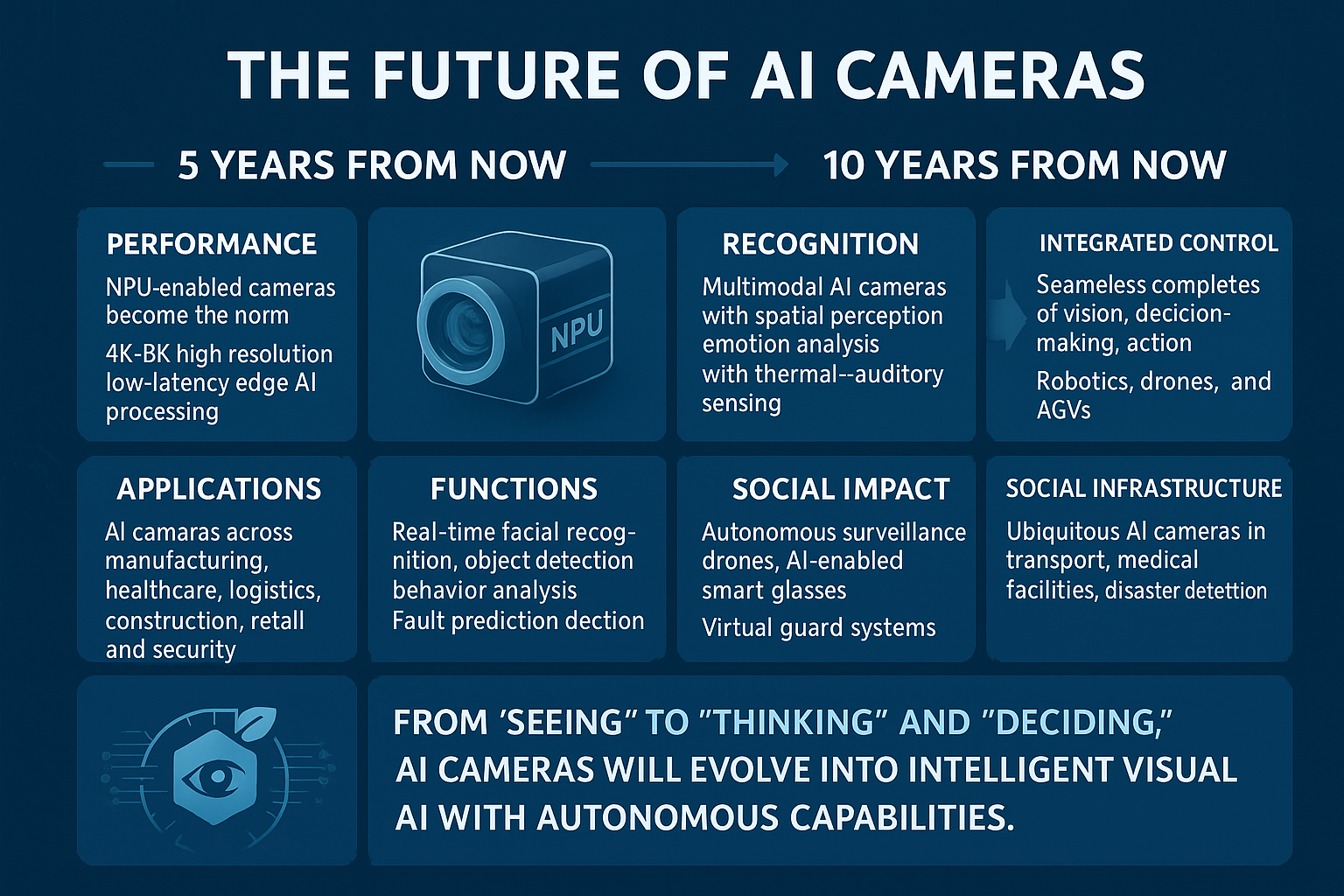

AIカメラの未来予測:5年後と10年後の進化ステージ

🔷 【5年後(2030年前後)】

▶ 社会実装の加速期/AI処理が“標準”になる時代

| 分野 | 進化内容 |

|---|---|

| 性能 | AI処理を行うNPU搭載カメラが標準化 4K〜8K高解像度 × 低遅延エッジAI処理 |

| 応用領域 | 製造/医療/物流/建設/小売/セキュリティなど、あらゆる業界でAIカメラが導入 |

| 機能 | 顔認識・物体検出・行動分析がリアルタイムで処理可 異常予測や統計収集にもAI活用が拡大 |

| 社会影響 | 人手不足を補う「無人監視・自動応答」が定着 プライバシー配慮とAI倫理が議論の中心に |

🔷 【10年後(2035年〜)】

▶ AIカメラ=“判断+制御”を担う視覚中枢へ進化

| 分野 | 進化内容 |

|---|---|

| 認識能力 | 空間認識/感情解析/温度・音など他センサーと統合したマルチモーダルAIカメラ |

| 制御統合 | ロボティクス・ドローン・AGVと連携し「見る→判断→動く」までを単体で完結 |

| 進化系 | 自律型監視ドローン/AI搭載スマートグラス/バーチャルガードシステムへ進化 |

| 社会インフラ | 交通インフラ、医療施設、災害検知にAIカメラが常設される社会構造に |

🔧 技術トレンド予測(自社共通)

| 項目 | 変化の方向性 |

|---|---|

| NPU性能 | 消費電力1W以下でAIモデル(YOLOv9、Transformer)常時稼働可能に |

| 通信 | 5G/6Gによりクラウド連携×ローカル推論のハイブリッド運用 |

| カメラ構造 | より小型化・低価格化・センサ統合が進行し、ユビキタス化へ |

🔽 まとめ

「目」から「脳」へ、そして「判断」へ。

AIカメラは、“見る装置”から“意思を持つ視覚AI”へと進化していく。

AI搭載カメラの今後(要約)

✅ 5年以内(2025〜2030年)

-

NPU(AIチップ)搭載が標準化し、リアルタイム画像解析が可能に

-

エッジAI処理が一般化し、クラウドレスでも高精度な判断が実現

-

製造・物流・医療・小売など、幅広い業界で実用化が加速

-

異常検知・顔認識・行動解析などが現場単位で実現される

✅ 10年後(2035年以降)

-

AIが「見る・理解する・判断して動く」までを自律的に実行

-

複数センサー統合によるマルチモーダルAIカメラへ進化

-

ドローンやロボットと融合し、完全自律型ビジュアルシステムとして社会インフラに組み込まれる

-

医療、災害対応、交通、警備などで不可欠な存在に

📌 まとめ:

「見るAI」から「判断するAI」へ。AIカメラは社会を“読む目”へと進化する。